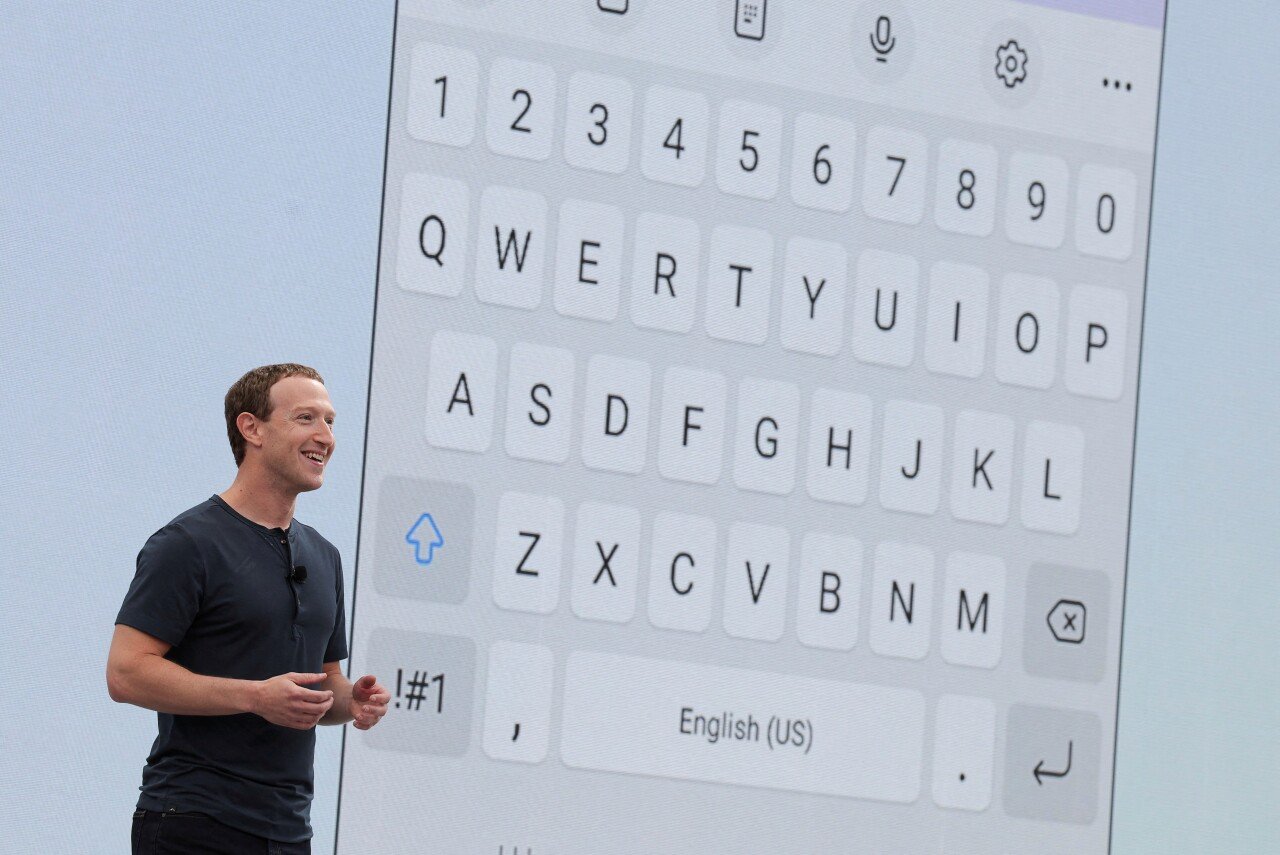

Hace una semana, Mark Zuckerberg, director ejecutivo de Meta, se reunió con el presidente electo de los Estados Unidos, Donald Trump, en su propiedad de Mar-A-Lago, en donde demostró su interés por asumir un “papel activo” en los debates del próximo gobierno, con la finalidad de mantener el liderazgo tecnológico del país. Durante una reunión virtual con medios de comunicación, Nick Clegg, presidente de Asuntos Globales de Meta, dijo que si bien no participó en tal reunión y no tiene comentarios al respecto, sí transmitió que Zuckerberg ha dejado en claro su intención por participar en las conversaciones del gobierno, particularmente sobre el papel que la IA jugará en ese escenario. Además, Clegg abordó la serie de decisiones y herramientas que implementaron durante el periodo de elecciones, como el hecho de que se le devolviera su cuenta de Facebook a Trump, incluso después del 6 de enero de 2021, fecha en que simpatizantes del empresario irrumpieron en el Capitolio de Estados Unidos.

Así se comportaron los usuarios de Meta durante las elecciones

Las restricciones a Trump se consideraron por dos publicaciones. En una de ellas acusaba el robo de los comicios frente a Joe Biden y fueron eliminadas por infringir las normas de la comunidad sobre personas y organizaciones peligrosas. Para este periodo electoral, tanto la empresa como Zuckerberg se mantuvieron al margen en cuanto a declaraciones sobre los candidatos, aunque, eso sí, Trump pudo volver a utilizar sus cuentas desde febrero de 2023. Clegg explicó que la decisión de restablecer las cuentas del empresario convertido a político se tomó bajo la idea de que “los candidatos y sus campañas pudieran utilizar nuestros servicios en igualdad de condiciones, por lo que no había ninguna diferencia entre los dos en el momento en que se celebraron las elecciones”. El 2024 fue el año más grande en términos de elecciones presidenciales en todo el mundo, pues más de tres cuartas partes del planeta salieron a las urnas. Ante este reto de moderación de contenido, Meta abrió equipos para vigilar sus plataformas durante los comicios.

El impacto de la IA en las elecciones

En el tema de libertad de expresión, Clegg reconoció que es complejo encontrar el balance entre permitir que las personas hagan escuchar sus voces y mantener su seguridad. “Es algo que ninguna plataforma hará bien al cien por ciento todo el tiempo”, afirmó. Entre las acciones más relevantes al respecto se encuentran el haber permitido a las personas hacer preguntas o expresar sus preocupaciones sobre los procesos electorales en el contenido orgánico. Sin embargo, no se dio cabida a afirmaciones o especulaciones sobre corrupción, irregularidades o prejuicios en las elecciones cuando se combinaba con señales que indicaran que el contenido era violencia intimidatoria. Asimismo, respecto al contenido pagado se prohibieron anuncios que cuestionaran la legitimidad de una elección. Por otra parte, se realizaron auditorías anuales sobre palabras que la empresa designa como groserías bajo sus políticas de Lenguaje que incita al odio, con el objetivo de mantener listas actualizadas que protejan a comunidades vulnerables y asegurarse de no cometer errores en la moderación del discurso público. Con el auge de la Inteligencia Artificial generativa la preocupación sobre su impacto en las elecciones también aumentó y de acuerdo con Meta hubo casos de uso confirmado o sospechoso de IA. No obstante, los volúmenes se mantuvieron bajos. Según datos de la plataforma Meta AI, se rechazaron 590,000 solicitudes para generar imágenes falsas (deepfakes) del presidente electo Trump, el vicepresidente electo Vance, la vicepresidenta Harris, el gobernador de Minnesota Tim Walz y el presidente Biden en el mes previo al día de las elecciones. “Nuestras políticas y procesos existentes demostraron ser suficientes para reducir el riesgo en torno al contenido de IA generativa. Durante el período electoral, las calificaciones sobre el contenido de IA relacionado con las elecciones, la política y los temas sociales representaron menos de 1% de toda la desinformación verificada”, comentó Clegg. La compañía informó que sobre el monitoreo del uso de la IA generativa por parte de campañas de influencia encubiertas (también conocidas como redes de comportamiento inauténtico coordinado o CIB), de las cuales se descubrió que han logrado mejoras incrementales en la productividad y la generación de contenido. Para combatir este asunto, la empresa dijo haberse centrado en desmantelar las operaciones de influencia, a través de la eliminación de las campañas y no en el contenido que publican, ya sea creado con IA o no. Si bien Clegg celebró el avance que tuvieron durante este año, también alertó en torno a que la prevalencia de estas herramientas de IA “claramente va a seguir creciendo en escala con el tiempo” desde un punto de vista de la desinformación, pero también de forma útil e incluso lúdica.

]]>